INFORME: Lo que se necesita para crear deepfakes como los usados por el chavismo para desinformar

Expertos creen que no estamos preparados para vivir en un mundo lleno de contenidos generados por IA, y temen que el acceso a esta tecnología erosione nuestra capacidad de confiar en todo lo que vemos en Internet.

Redacción | NPR

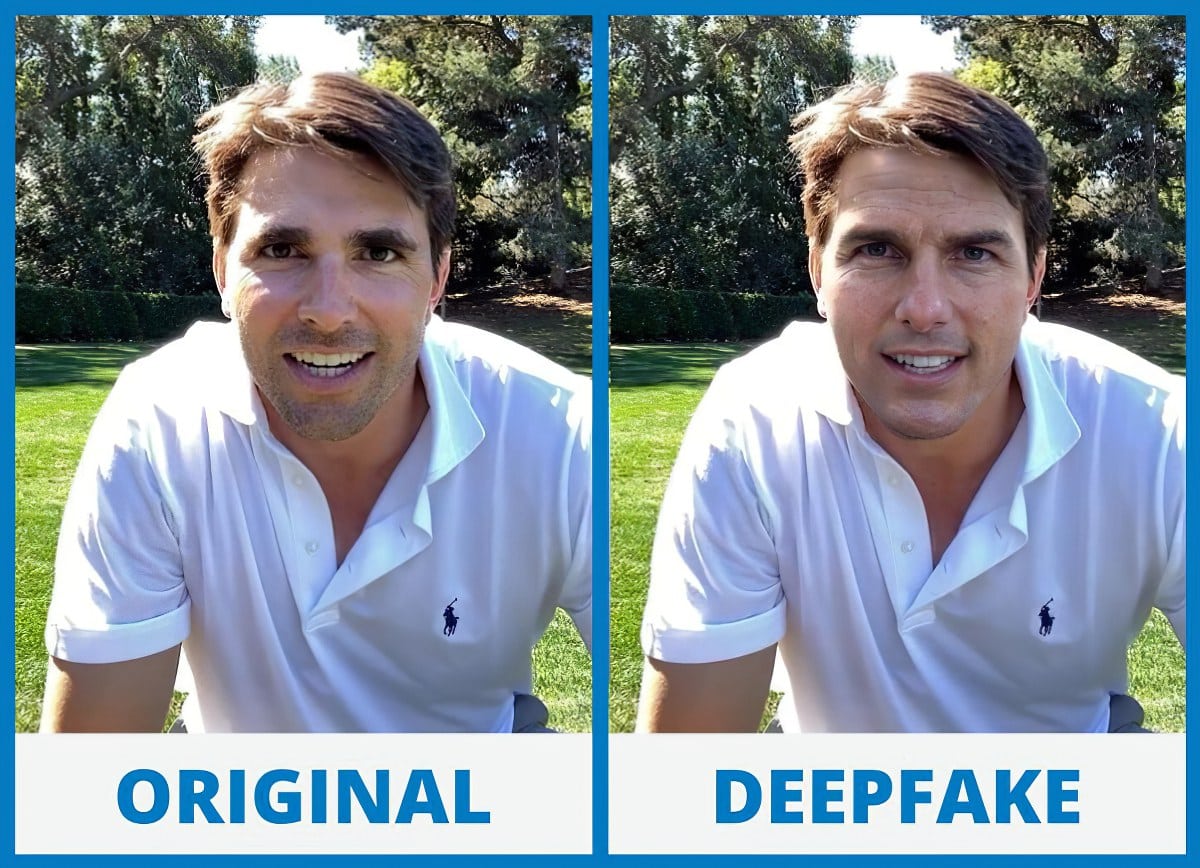

A primera vista, el vídeo que Ethan Mollick publicó en LinkedIn el mes pasado parece y suena como lo que cabría esperar de un profesor de negocios de la Wharton School de la Universidad de Pensilvania. Lleva una camisa de cuadros y da una charla sobre un tema con el que está muy familiarizado: el espíritu empresarial.

Claro, su discurso es rígido y su boca se mueve de forma extraña. Pero si no le conocieras bien, probablemente no te lo pensarías dos veces.

Pero el vídeo no es Ethan Mollick. Es un deepfake creado por el propio Mollick, utilizando inteligencia artificial para generar sus palabras, su voz y su imagen en movimiento.

With just a photograph & 60 seconds of audio, you can now create a deepfake of yourself in just a matter of minutes by combining a few cheap AI tools. I've tried it myself, and the results are mind-blowing, even if they're not completely convincing. More: https://t.co/6GfHrI0YhQ

— Ethan Mollick (@emollick) February 10, 2023

«Fue sobre todo para ver si podía, y luego darme cuenta de que es mucho más fácil de lo que pensaba», dijo Mollick en una entrevista con NPR.

Como muchos de los que han seguido de cerca la rápida aceleración de la tecnología de IA, Mollick está entusiasmado con la posibilidad de que estas herramientas cambien nuestra forma de trabajar y nos ayuden a ser más creativos.

Pero forma parte del creciente coro de personas preocupadas por que esta proliferación de lo que se conoce como «IA generativa» potencie la propaganda y las campañas de influencia negativas.

Mollick da clases de innovación a futuros empresarios y ejecutivos. Últimamente se ha metido de lleno en un nuevo conjunto de herramientas basadas en IA que cualquiera puede utilizar ahora para crear imágenes, texto, audio y vídeo de gran verosimilitud, desde chatbots como ChatGPT de OpenAI y Bing de Microsoft hasta generadores de imágenes como DALL-E y Midjourney.

«Me he convertido en un susurrador de IA», dice Mollick riendo. Ahora exige a sus alumnos que utilicen IA y relata sus propios experimentos en sus redes sociales y en su boletín.

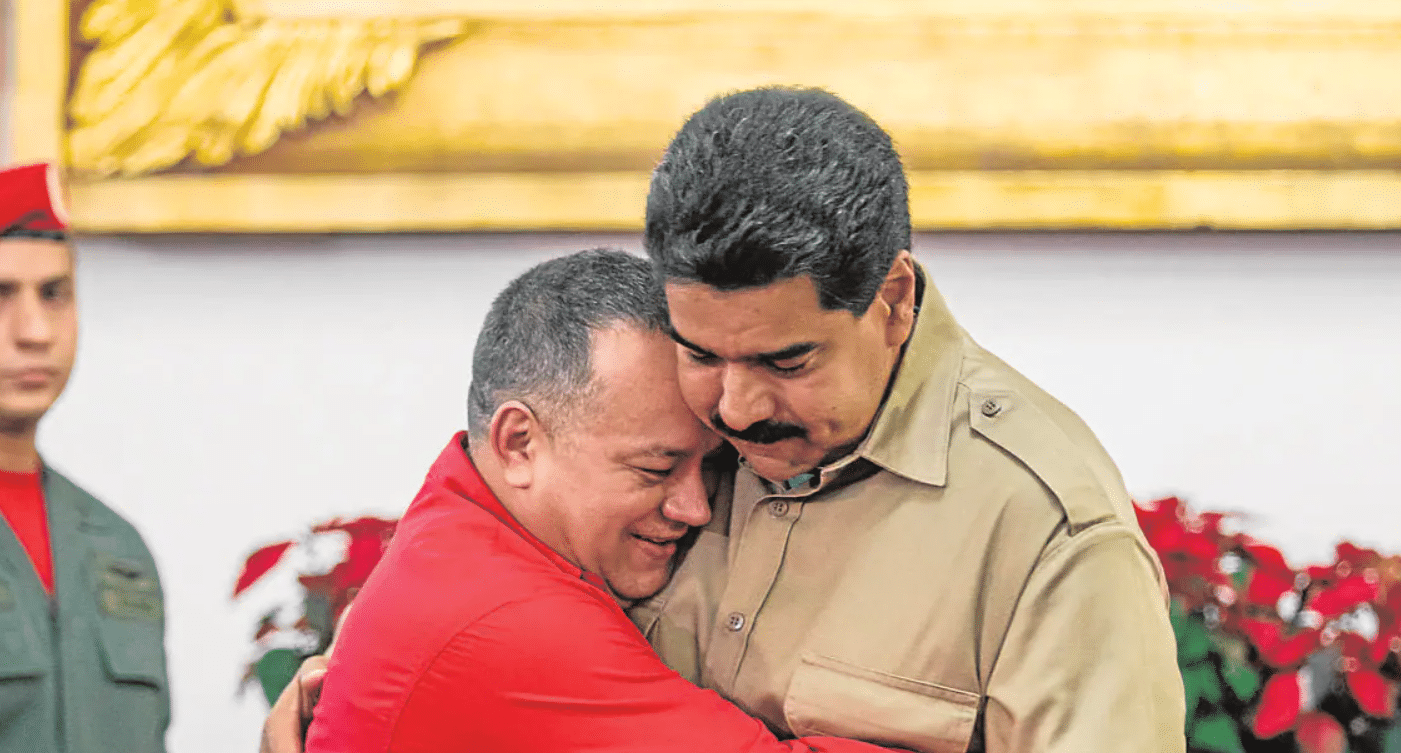

LEA TAMBIÉN: Maduro usa Inteligencia Artificial para promocionar la falsa «recuperación económica» de Venezuela

Rápido, fácil y barato

Mollick empezó con ChatGPT, el chatbot de OpenAI que explotó en popularidad cuando debutó en noviembre y ha desencadenado una carrera entre las empresas tecnológicas por lanzar IA generativa.

«Le dije: ‘Escribe un guión que Ethan Mollick diría sobre el espíritu empresarial’, y lo hizo bastante bien», explica. A continuación, recurrió a una herramienta capaz de clonar una voz a partir de un breve clip de audio.

«Le di un minuto mío hablando de un tema no relacionado, como el queso, y luego pegué el discurso y generó el archivo de sonido».

Por último, introdujo ese audio y una foto suya en otra aplicación de IA.

«Le pones un guión y te mueve la boca y los ojos de forma realista y te hace encogerte de hombros. Y eso era todo lo que necesitaba», explica.

Fue rápido, fácil y barato. Mollick gastó 11 dólares y sólo ocho minutos en hacerla.

«Al final, me tenía a mí -un falso yo- dando una conferencia falsa que nunca he dado en mi vida, pero que suena como yo, con mi voz falsa», dijo.

Mollick colgó su experimento en Internet como demostración, y advertencia, de que los riesgos de este tipo de IA no están en un futuro lejano, sino que ya están aquí.

«Creo que la gente no está suficientemente preocupada por esto», afirma. «Yo soy alguien que está bastante a favor de esta tecnología en muchos aspectos. Pero también creo que no estamos preparados para las implicaciones sociales de poder engañar a la gente a gran escala. … La idea de que cualquiera pueda hacer esto es un fenómeno nuevo».

Ya existen vídeos e imágenes falsas de Biden y Trump

La preocupación por los deepfakes existe desde hace años. La diferencia es que ahora la tecnología ha avanzado y está al alcance de cualquiera con un smartphone o un ordenador.

La gente se divierte utilizándolos para bromas y memes, como la tendencia viral de TikTok de vídeos que utilizan audio sintético para imitar a los presidentes Donald Trump, Barack Obama y Joe Biden jugando a videojuegos.

Pero los deepfakes ya se utilizan con fines políticos.

Jack Posobiec, un activista conocido por promover la teoría de la conspiración del Pizzagate, creó recientemente un vídeo falso del presidente Biden anunciando un proyecto para enviar soldados estadounidenses a Ucrania.

AI imagines what would happen if Biden declares and activates the Selective Service Act and begins drafting 20 years old to war pic.twitter.com/896Htrtteu

— The Post Millennial (@TPostMillennial) February 27, 2023

Aunque Posobiec explicó que el vídeo era una falsificación creada por la IA, también lo describió como «un adelanto, próximas atracciones, un vistazo al mundo del más allá».

Muchos compartieron el vídeo sin avisar que no era real.

Esta semana, millones de usuarios de Twitter vieron imágenes falsas generadas por IA que mostraban cómo sería si el expresidente Trump fuera detenido, en medio de especulaciones de que un gran jurado de Nueva York podría acusar pronto al expresidente. Una foto probablemente falsa del líder chino Xi Jinping reunido con el presidente ruso Vladimir Putin también fue ampliamente compartida en línea.

Propaganda y las estafas generadas por IA

A finales del año pasado, la empresa de investigación Graphika identificó el primer caso conocido de una operación de influencia estatal mediante deepfakes. Los investigadores descubrieron bots prochinos que compartían vídeos de noticias falsas, con presentadores generados por inteligencia artificial, en Facebook y Twitter.

Mientras tanto, los estafadores utilizan audios falsos para robar dinero haciéndose pasar por familiares en crisis.

«La ecosfera de la información se va a contaminar», afirma Gary Marcus, científico cognitivo de la Universidad de Nueva York que estudia la IA.

Dice que no estamos preparados para lo que significa vivir en un mundo lleno de contenidos generados por IA, y teme que el acceso generalizado a esta tecnología erosione aún más nuestra capacidad de confiar en todo lo que vemos en Internet.

«Un mal actor puede tomar una de estas herramientas… y usarla para crear cantidades inimaginables de desinformación realmente plausible, casi aterradora, que la persona promedio no va a reconocer como desinformación», dijo Marcus.

«Eso puede completarse con datos, referencias falsas a estudios que ni siquiera han existido antes. Y no sólo una historia como ésta, que podría escribir un humano, sino miles o millones o miles de millones, porque se pueden automatizar estas cosas.»

Textos de las IA será más difícil de detectar que las imágenes y los vídeos

Marcus y otros observadores de la rápida difusión de la IA al público están especialmente preocupados por un nuevo conjunto de herramientas que crean texto: la tecnología que utilizan Bing, ChatGPT y Bard, el nuevo chatbot que Google ha lanzado esta semana.

Estas herramientas están entrenadas para identificar patrones en el lenguaje ingiriendo grandes cantidades de texto de Internet. Pueden generar artículos de noticias, ensayos, mensajes de Twitter y conversaciones que suenan como si las hubieran escrito personas reales.

«Los modelos lingüísticos son una herramienta natural para los propagandistas», afirma Josh Goldstein, investigador del Centro de Seguridad y Tecnologías Emergentes de la Universidad de Georgetown. Goldstein es coautor de un artículo reciente en el que se examina el uso indebido de estas herramientas de inteligencia artificial en operaciones de influencia.

«Utilizando un modelo lingüístico, los propagandistas pueden crear montones y montones de texto original, y pueden hacerlo rápidamente y a bajo coste», dijo.

Eso significa que una granja de trolls puede necesitar menos trabajadores y que las campañas de propaganda a gran escala podrían estar al alcance de una mayor variedad de malos actores.

Es más, los investigadores han descubierto que los contenidos creados por IA pueden ser realmente convincentes.

«Se puede generar propaganda persuasiva aunque no se domine del todo el inglés o aunque no se conozcan los modismos de la comunidad a la que se quiere llegar», afirma Goldstein.

El texto generado también puede ser más difícil de detectar que el vídeo o el audio falsificados. Las campañas en línea que utilizan IA para escribir mensajes pueden parecer más orgánicas que los mensajes de copiar y pegar que suelen asociarse a los bots.

E incluso si el contenido escrito con IA no siempre tiene éxito en la persuasión, para los propagandistas eso es una característica, no un error. El temor es que esta profusión de texto generado amplifique lo que se denomina la «manguera de fuego de la falsedad», una estrategia de propaganda que difunde indiscriminadamente mensajes falsos y a menudo contradictorios.

El ex asesor de Trump Steve Bannon tenía otra frase para esto: «inundar la zona con mierda».

«Si quieres inundar la zona con mierda, no hay mejor herramienta que ésta», dijo Marcus.

Para ser claros, los investigadores aún no han identificado una operación de propaganda o influencia que utilice texto generado.

Si quieres recibir en tu celular esta y otras noticias de Venezuela y el mundo descarga Telegram, ingresa al link https://t.me/primerinforme y dale click a +Unirme.